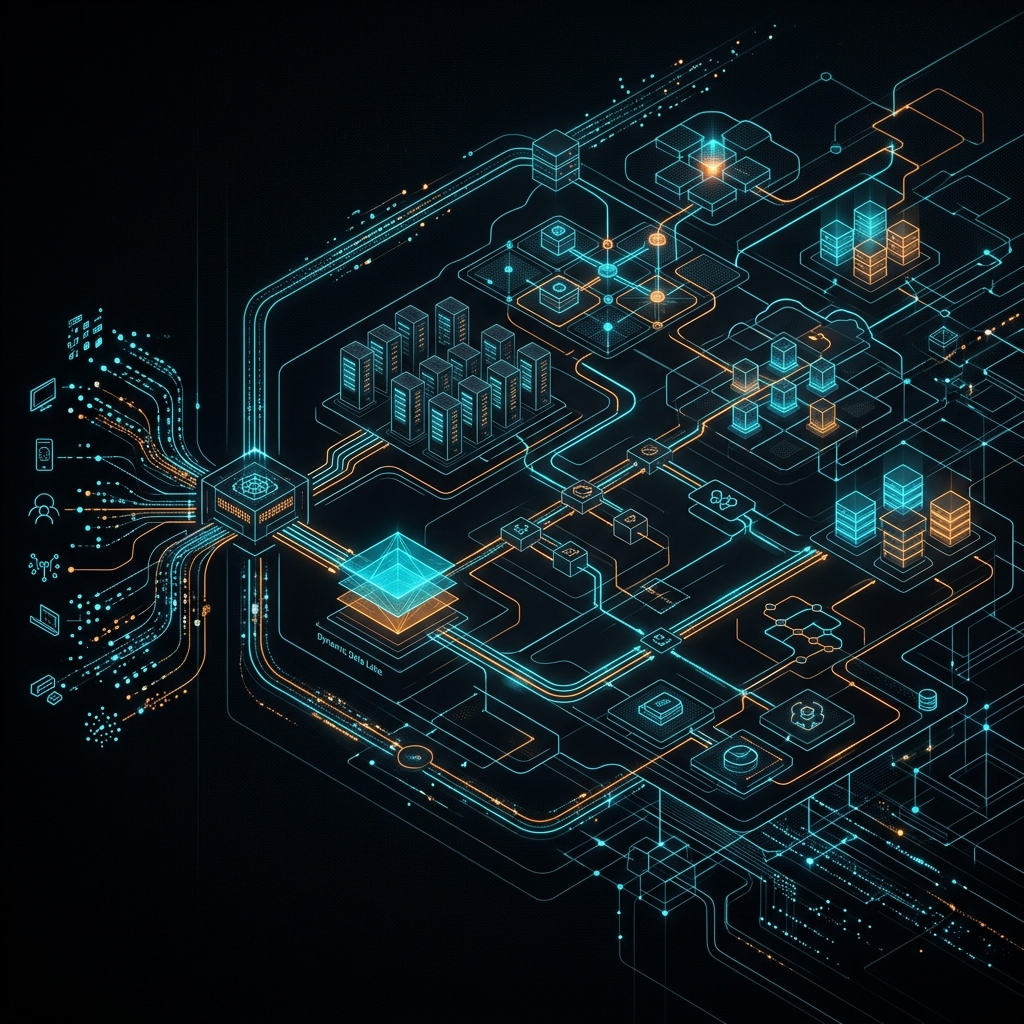

High-Performance

Data Architectures

Diseñamos y ejecutamos ecosistemas de datos escalables. Especialistas en optimización de costos en AWS y pipelines masivos de información.

Diseñamos y ejecutamos ecosistemas de datos escalables. Especialistas en optimización de costos en AWS y pipelines masivos de información.

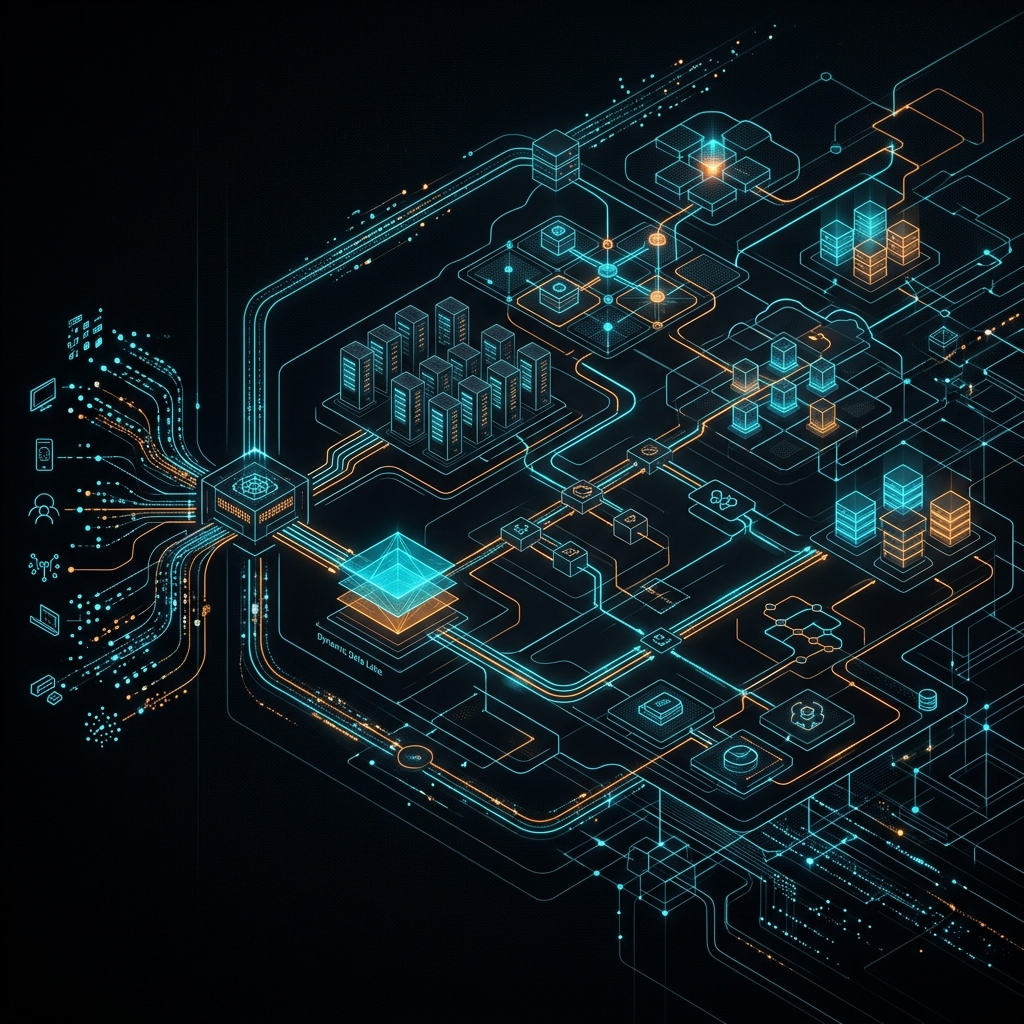

No implementamos recetas estáticas. Diseñamos la topología óptima segregando los planos de control y de datos según los requerimientos de carga, escala y costo de cada cliente.

Modelamos la topología óptima segregando flujos de datos y planos de control para garantizar el throughput requerido y la escalabilidad del Modern Data Stack.

Diseño de infraestructuras críticas (Lakehouse/Data Mesh). Priorizamos la integridad y seguridad del dato desde la ingesta hasta el consumo analítico.

Scalability • IntegrityIngeniería de cómputo distribuido con PySpark. Maximizamos el rendimiento de sus flujos de datos reduciendo drásticamente los tiempos de ejecución.

Throughput • Low LatencyConectamos el pasado con el futuro. Especialistas en modernizar sistemas core en Java hacia arquitecturas cloud-native sin pérdida de contexto.

Legacy Modernization • Cloud-NativeUtilizamos herramientas líderes de la industria para garantizar estabilidad y velocidad de entrega en entornos de producción críticos.

AWS Glue

AWS Lambda

Amazon S3

Redshift

Python/PySpark

¿Listo para escalar su infraestructura de datos?

Nuestro equipo técnico responderá directamente. Sin intermediarios comerciales.